a nova ontologia computacional

O sociólogo italiano Vania Baldi, autor de Optimizados e Desencontrados: Ética e crítica na era da inconsciência artificial, adoptando uma perspectiva que deve muito à filosofia e à antropologia da técnica, elabora neste artigo uma reflexão que contraria a crença ilimitada, o optimismo cego e a negligência ética em relação aos novos sistemas da Inteligência Artificial.

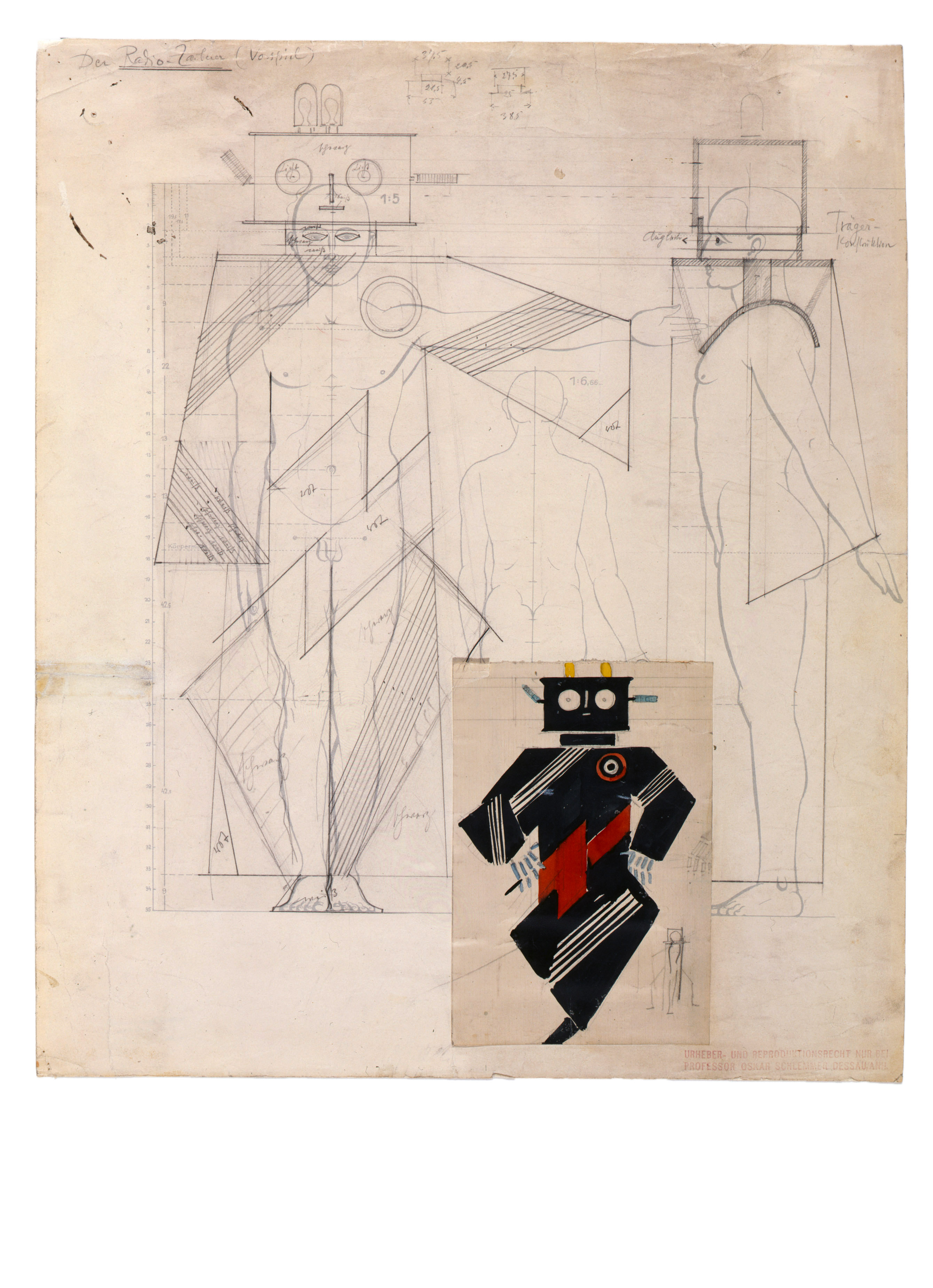

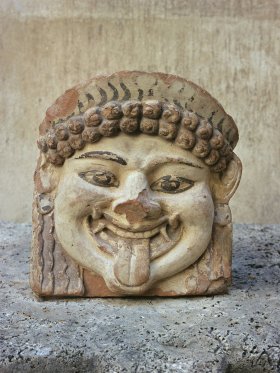

Oskar Schlemmer, Radio-Wizard [Rádio-mago], 1928 © Fotografia: Scala, Florença /

bpk, Bildagentur für Kunst, Kultur und Geschichte, Berlim / Theaterwissenschaftliche Sammlung der Universität zu Köln, Schloss Wahn, Colónia

Quais as razões para analisar e debater a natureza da propagandeada «inteligência generativa» dos novos sistemas de Inteligência Artificial (IA)? Questionar apenas o conceito de «inteligência» empregue no domínio dos serviços e produtos digitais, bem como na mediatização que lhes diz respeito, poderia parecer por si só um capricho linguístico ou um purismo conceptual. Todavia, ao juntar-se o adjectivo «generativa», a perplexidade estende-se para um âmbito mais amplo, onde às preocupações de ordem teórica se juntam as éticas e políticas.

A infoesfera, que tudo absorve, regista, calcula e categoriza, representa a nossa nova ontologia computacional, realidade constituída por sistemas de IA que medem e processam fluxos infinitos de dados numa lógica de aprendizagem automatizada desenhada por algoritmos. As razões para questionar o tipo de inteligência aqui em jogo provêm, então, da dúvida de que aquilo que nos define como humanos e como seres sociais tenha ficado no imaginário colectivo como algo obsoleto e irrelevante. As nossas capacidades de agir, pensar, avaliar, projectar e, não menos importante, de mudar tornaram-se antiquadas?

Antes de retomar tais interrogações, antropologicamente existenciais, vale a pena referir duas investigações recentes que corroboram a perplexidade acerca do imaginário colectivo em questão. A primeira revela o quão enraizada está no senso comum a descrença nas instituições políticas e a crença nas virtudes da tecnologia. Trata-se de um inquérito realizado pelo IE Center for the Governance of Change, no qual a uma amostra de 2769 cidadãos de onze países dos vários continentes foi perguntado: «É melhor um algoritmo ou uma política gerida por legisladores reais?» Na Europa, refere o inquérito, o algoritmo ganhou com 51%, enquanto na China, três em cada quatro entrevistados escolheram o algoritmo.

O segundo exemplo remete-nos para uma revisão da literatura publicada em 2021 sobre a presença de preocupações éticas no campo das ciências da computação e programação: de entre os cem artigos mais citados publicados nos últimos quinze anos nas actas das duas conferências anuais mais importantes do sector (a NeurTPS e a ICML), apenas dois mencionaram e discutiram os perigos potenciais das aplicações de IA apresentadas. Os restantes noventa e oito não mencionam perigo algum, eliminando assim a possibilidade de os discutir, apesar de muita da investigação lidar com áreas de aplicação socialmente controversas, tais como a vigilância e a desinformação1.

Dois exemplos, entre outros, que nos mostram a transversalidade da ingenuidade crítica em relação aos processos de inovação tecnológica e que nos remetem para uma visão da IA que não vai além da optimização computacional para que foi concebida. O debate dinamizado pelas empresas tecnológicas aparenta focar-se na aplicabilidade da IA no dia-a-dia, em particular nas suas funcionalidades crescentes para a produtividade, sem questionar o que nós, enquanto comunidade social e política, queremos fazer com ela. Ademais, ao associar a inteligência a mecanismos de multiplicação do desempenho na gestão de tarefas, as narrativas mediáticas desenhadas pelos grandes investidores em IA revelam uma maneira instrumental de conceber a inteligência humana. Também os alarmes sobre os riscos de substituição ou extinção humana inscrevem-se no registo do marketing e das relações públicas, onde os anúncios e as especulações sobre determinadas expectativas visam gerar uma «bolha» cujo valor prescinde das suas reais efectivações.

O que aqui está em causa, portanto, não é a «vergonha prometeica» analisada por Günther Anders no rescaldo da Segunda Guerra Mundial, vergonha resultante do sentimento de insignificância que os humanos sentiriam diante das próprias criações tecnológicas. É, pelo contrário, um sentimento de optimismo cego e euforia infantil (a «calamidade triunfal» assinalada por Adorno e Horkheimer em Dialéctica do Iluminismo), o que pode vir a criar os piores cenários (como já deveríamos ter aprendido ao longo dos últimos vinte anos com a ideologia do admirável mundo novo criada pelo mercado digital).

Talvez a primeira urgência à qual somos convocados pela propagação e pelo desenvolvimento da IA corresponda à oportunidade de termos de definir, antes, o tipo de sociedade que se pretende construir aproveitando este processo de reontologização computacional. Se tivermos, como sociedade, um projecto político, podemos tentar rentabilizar as influências da IA em prol de interesses finalmente alheios aos da finança, do entretenimento sociopático e da competição como bitola dos valores sociais. Em síntese, se ficar decidido que a IA deve ser governada numa lógica de utilidade social, então, torna-se imprescindível compreender a peculiaridade da sua inteligência para tirar proveito das lógicas e arquitecturas computacionais que a dinamizam. Nesta perspectiva, é necessário entender o que podemos realmente esperar dela, uma vez que os seus sistemas automatizados não devem criar ilusões sobre a sua autonomia e não devem ser confundidos com capacidades de autogestão.

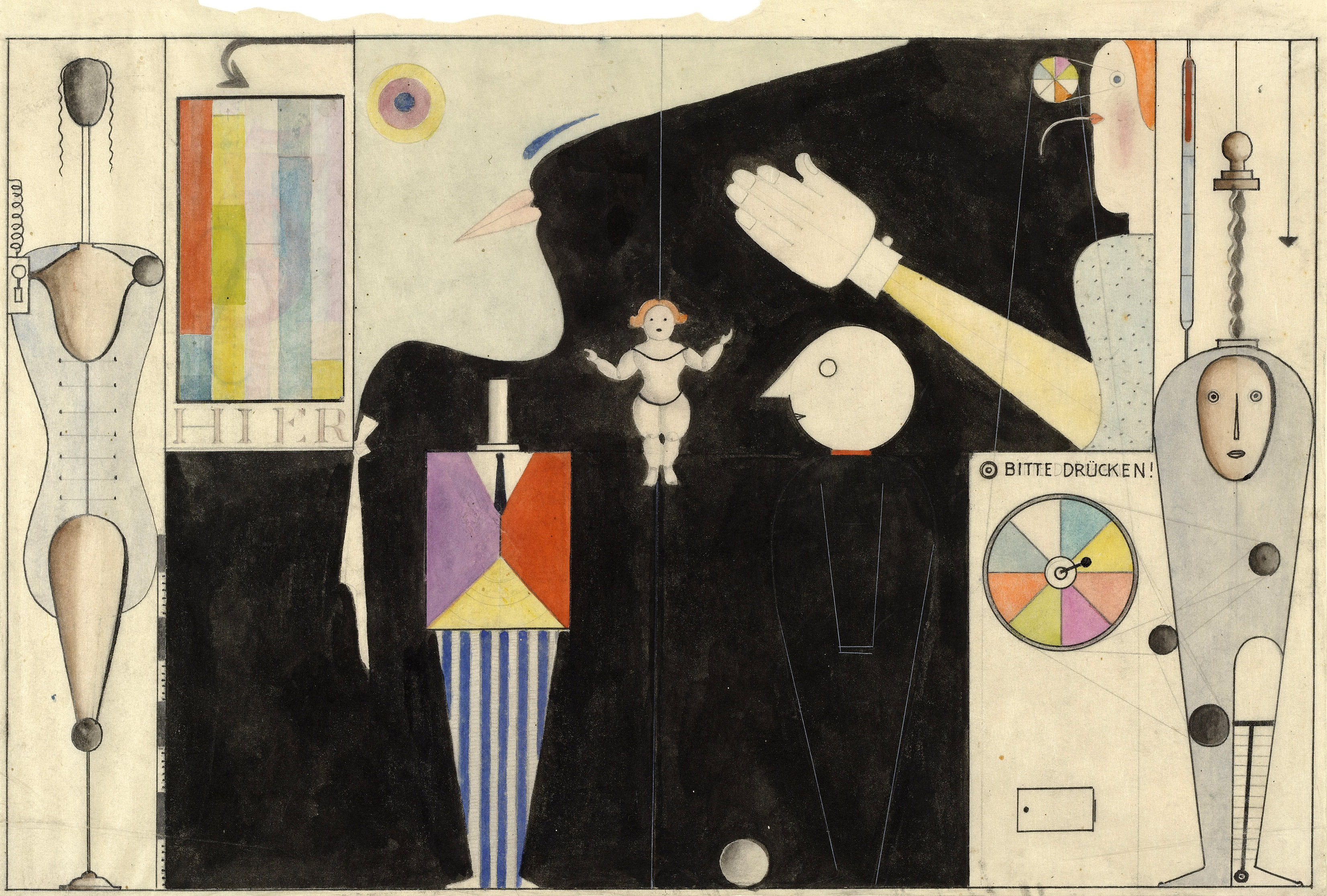

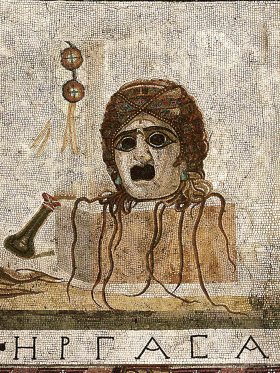

Oskar Schlemmer, Das figurale Kabinett [O gabinete figural], 1922 © Fotografia: Scala, Florença / The Museum of Modern Art, Nova Iorque

agir como interfaces no meio de outras interfaces

Como actua a IA? Quais são as suas características operativas? A sua maneira de agir reflecte alguma plasticidade cognitiva? Os seus procedimentos implicam dúvidas e adaptabilidade aos contextos? Será que a acção e a inteligência podem andar separadas?

Existem diferentes tipos de acções: algumas exigem motivação, intenção, um estímulo do ambiente social que viabilize o amadurecimento de uma orientação psicológica, uma capacidade de fazer frente a contingências inesperadas; outro tipo de acções é aquele maquinal que executa e obedece a uma lógica de input/output. Os sistemas de IA aplicam a segunda lógica de fazer/agir de modo tecnologicamente predeterminado, sem uma faculdade intelectiva que lhes permita uma apreciação sobre aquilo que está em jogo, uma suspensão do juízo, uma flexibilidade face aos imprevistos ou uma reflexão retrospectiva.

Agir, no aspecto psicológico e sociológico, implica uma intencionalidade baseada na consciência histórica e na consciência de si, requer pedidos de clarificação, ponderação dos valores envolvidos, tempo para conciliar o próprio sentir com o que é socialmente perspectivado como conveniente: em suma, razões justificáveis para agir segundo o modo escolhido ou para mudar de ideias e recuar. Neste sentido, uma acção intencional está ligada, também, à responsabilidade, a uma reflexão ética que remete para contextos culturais imbuídos de histórias, relações, paixões e valores implícitos. Por outro lado, as escolhas realizadas por sistemas de IA são feitas de forma automatizada, através de uma lógica computacional pouco inteligível, levantando dúvidas de cariz moral sobre as razões das suas acções.

[...]

Partilhar artigo